Audyt SEO to wynik analizy strony internetowej lub sklepu internetowego pod kątem zgodności z wytycznymi przygotowanymi przez twórców wyszukiwarek internetowych. SEO audyt strony jest przeprowadzany pod względem czynników wpływających na pozycję strony w wynikach wyszukiwania (z ang. SERP – Search Engine Results Page).

Przeprowadzane przez naszą agencję marketingu internetowego audyty SEO są bardzo pomocne i wykorzystywane przez twórców stron internetowych, agencje tworzące strony i sklepy internetowe, copywriterów i specjalistów zajmujących się tworzeniem strategii marketingu w wyszukiwarkach internetowych.

Profesjonalny Audyt SEO to

Klienci

Poznasz w jaki sposób klienci szukają twoich usług i produktów i jak optymalizować stronę pod SEO

Widzialność

Dzięki wprowadzaniu wytycznych z audytu wzrasta widoczność strony w wyszukiwarce

Rozwój biznesu

Dzięki audytowi SEO będziesz mógł skuteczniej i pewniej rozwijać swoją stronę internetową

Zdobycie przewagi

Dzięki audytowi SEO strony internetowej zdobędziesz przewagę nad konkurencją w wynikach wyszukiwania

Co daje optymalizacja SEO strony?

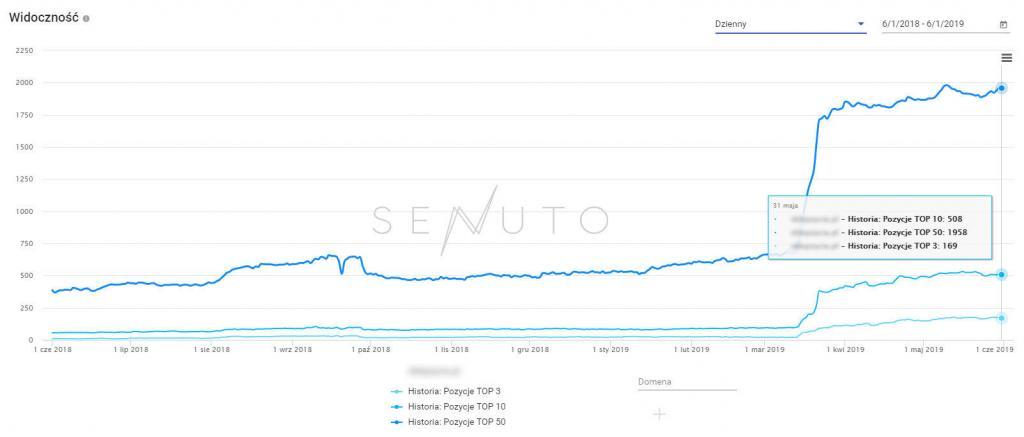

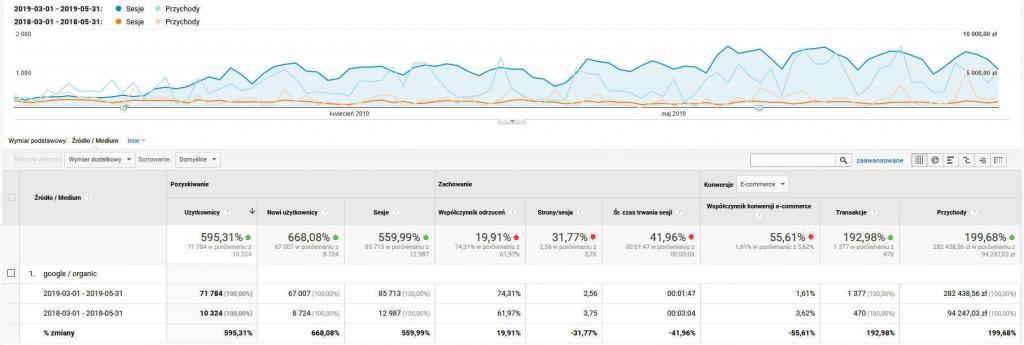

Optymalizacja SEO strony powinna odbywać się na podstawie audytu SEO, który pozwala znaleźć jej najważniejsze elementy do poprawy. Dzięki poprawie elementów i wprowadzeniu wytycznych z audytu pozycja strony internetowej w wynikach wyszukiwania Google ulega zmianie w kierunku wyższych pozycji. Poniżej prezentujemy Ci efekty optymalizacji sklepu internetowego na podstawie audytu SEO.

W przedstawionym przykładzie audyt został wykonany pod koniec 2018 roku, a najważniejsze zmiany zostały wprowadzone do końca lutego 2019 roku. Jak widzisz doszło do bardzo szybkiego zwiększenia pozycji słów kluczowych w sklepie internetowym. Zmiany te spowodowały wzrost ilości zamówień dla użytkowników pochodzących z naturalnych wyników wyszukiwania. Dzięki efektowi, który uzyskaliśmy udało się prawie potroić przychody w sklepie bez wprowadzania dodatkowych działań związanych z optymalizacją konwersji.

Zadzwoń i porozmawiajmy

o audycie SEO strony internetowej

Dla Kogo Polecamy Audyt SEO

Audyt SEO strony internetowej powinien zamówić każdy, komu zależy na zwiększaniu widoczności strony w wynikach wyszukiwania Google. Szczególnie polecamy wykonanie audytu posiadaczom stron internetowych. Jeśli prowadzisz sklep internetowy to wykonamy dla Ciebie audyt SEO sklepu internetowego.

Kolejną grupą, której dedykujemy tę usługę są freelancerzy, osoby oraz agencje tworzące strony i sklepy internetowe. Dzięki audytowi SEO aktualnej lub nowo tworzonej witryny internetowej wprowadzisz niezbędne elementy tak, aby Twój klient był bardziej zadowolony z tworzonego dzieła.

Jeśli chcesz przenieść stronę internetową i ją przebudować to również powinieneś skorzystać z audytu. Będziesz miał pewność, że wprowadzane przez Ciebie zmiany przyniosą dobry skutek w wyszukiwarce Google.

Jeśli zarządzasz lub pracujesz w dziale marketingu i chciałbyś rozszerzyć swoją strategię marketingu internetowego o element jakim jest strategia SEO, to również powinieneś wykonać profesjonalny audyt SEO.

Ostatnią grupą, której polecamy audyt są osoby i firmy korzystające z usług pozycjonowania agencji i specjalistów. Dzięki temu sprawdzisz, czy firma której płacisz co miesiąc pewną kwotę wykonuje ważne dla Twojej firmy kroki zwiększającą Twój zasięg w wyszukiwarce.

Audyt SEO Narzędzia

Wykonanie profesjonalnego audytu SEO wymaga zastosowania w umiejętny sposób odpowiednich narzędzi. W trakcie wykonywania audytu SEO wykorzystujemy, Google Structured Data Testing Tool,Google Search Console, Google Analytics, SENUTO, Surfer SEO, SEO SpyGlass, Clusteric Search Auditor, SEMSTORM, Sitebulb.

Aby dać Ci jak najlepsze dane będziemy potrzebowali dostępu do FTP celem autoryzacji Google Serach Console oraz dostępu na poziomie widoku i przeglądania Google Analytics. Dzięki tym dostępom będziemy mogli lepiej zbadać sytuację obecną strony internetowej lub sklepu internetowego. Możemy wykonać audyt bez tych dostępów, jednak będzie on wtedy uboższy o cenne informacje dla Twojej strony.

Zadzwoń i porozmawiajmy

o audycie SEO sklepu

Audyt SEO Cena

Cena audytu SEO uzależniona jest od wielu czynników takich jak wielkość i rozbudowanie strony internetowej lub sklepu internetowego. Darmowy audyt SEO, który możesz znaleźć na stronach internetowych jest zwykłym raportem z danej podstrony. Cena audytu SEO to składowa pracy specjalistów, koszty narzędzi i wiele godzin doświadczenia oraz ogrom zdobytej wiedzy w dziedzinie SEO.

Do każdego zlecenia podchodzimy indywidualnie, jednak nie możemy wykonać usługi taniej niż faktycznie ona kosztuje. Cennik SEO, który widzisz poniżej podlega negocjacji.

Tani audyt SEO może nie wyczerpać całkowicie tematu i nie uzyskasz na jego podstawie konkretnych i rzeczowych wytycznych albo wytyczne, które otrzymasz nie wpłynął na pozycje strony w wynikach wyszukiwania.

Mini Audyt SEO

dla małych lokalnych stron- Analiza widoczności strony internetowej

- Analiza słów kluczowych

- Analiza konkurencji

- Analiza linkowania zewnętrznego

- Audyt SEO PDF + załączniki

- Wytyczne do zmian

- Rabat na pozycjonowanie lokalne

663 228 274

Audyt SEO

dla stron internetowych- Analiza widoczności strony internetowej

- Analiza słów kluczowych

- Analiza konkurencji

- Analiza linkowania zewnętrznego

- Audyt SEO w formacie PDF + załączniki

- Wytyczne do zmian

- Rabat na pozycjonowanie strony

663 228 274

Audyt SEO Ecommerce

dla sklepów internetowych- Analiza widoczności sklepu internetowego

- Analiza słów kluczowych

- Analiza konkurencji

- Analiza linkowania zewnętrznego

- Audyt SEO sklepu w formacie PDF wraz załącznikami

- Wytyczne do zmian

- Rabat na pozycjonowanie sklepu

663 228 274

Zadzwoń i porozmawiajmy

o audycie SEO strony

Co zawiera Audyt SEO sklepu lub strony

Indeksowanie przez wyszukiwarki

Strony z kodem odpowiedzi 4xx

Kody 4xx wskazują na błąd na stronie. Na przykład, jeśli masz nie działający link na stronie, klikając go, odwiedzający może zobaczyć błąd 4xx. Ważne jest, aby regularnie monitorować te błędy i badać ich przyczyny, ponieważ mogą one mieć negatywny wpływ i zmniejszać autorytet witryny w oczach użytkowników i wyszukiwarki.

Zasoby z kodem stanu 5xx

Komunikaty o błędach 5xx są wysyłane, gdy serwer zgłasza, że ma problem lub istnieje błąd. Ważne jest, aby regularnie monitorować te błędy i zbadać ich przyczyny, ponieważ mogą one mieć negatywny wpływ i zmniejszać moc witryny w oczach wyszukiwarek.

Strony indeksowane z ograniczeniami

Strona może być ograniczona z indeksowaniu na kilka sposobów: w pliku robots.txt, przez tag X-Robots NOINDEX lub przez tag NOINDEX w Meta. Każdy z nich jest linią kodu HTML, który mówi, jak roboty powinny obsługiwać określone strony w witrynie. Konkretnie, znacznik informuje roboty, czy strony są dopuszczone do indeksowania, czy robot może podążać za linkami lub archiwizować zawartość. Należy upewnić się, czy strony z unikalnymi i przydatnymi treściami są dostępne do indeksowania.

Poprawna konfiguracja strony 404

Zwyczaj strona błędu 404 może pomóc zachować użytkowników na stronie. W idealnym świecie, należy poinformować użytkowników, że strona, której szukasz, nie istnieje, i wyposażyć ją w takie elementy, jak: mapa strony HTML, pasek nawigacyjny, i pole wyszukiwania Ale co najważniejsze, 404 strona błędu powinna zwrócić kod odpowiedzi 404. Może się to wydawać oczywiste, ale niestety rzadko tak jest.

Plik robots.txt

Plik robots.txt jest automatycznie indeksowany przez roboty, kiedy przechodzą przez twoją stronę. Ten plik powinien zawierać polecenia dla robotów, takie jak strony, które powinny lub nie powinny być indeksowane . Musi być dobrze sformatowany, aby wyszukiwarki mogły go indeksować i przeczytać. Należy pamiętać, że polecenia umieszczone w pliku robots.txt są raczej dyrektywami, a nie bezwzględnymi regułami do wykonania przez roboty. Nie ma gwarancji, że niektóre nieposłuszne roboty nie będą sprawdzać zawartości, które zostały niedozwolone. Dlatego, jeśli masz jakieś tajne lub poufne treści witryny, robots.txt nie jest sposobem, aby je zablokować przed publicznym dostępem.

Plik sitemap.xml

Sitemap XML powinna zawierać wszystkie strony witryny, które chcesz indeksować, i powinna być umieszczona w strukturze katalogu głównego (np. http://www.ibb.media/sitemap.xml ). Na ogół służy do wspomagania indeksowania.

Powinna być aktualizowana, gdy nowe strony są dodawane do witryny, i musi być prawidłowo zakodowana. Poza tym, w mapie witryny można ustawić ważność każdej strony, co mówi wyszukiwarkom, które strony należy częściej indeksować (tzn. są aktualizowane częściej).

Przekierowania

Wersje z www i bez www

Zazwyczaj strony internetowe są dostępne z lub bez „www” w nazwie domeny. Ten problem jest dość powszechny, a ludzie odwołują się do obu wersji z www i bez www. Poprawienie tego pomoże uniknąć wyszukiwarkom indeksowania obu wersji witryny. Chociaż takie indeksacje nie spowodują kary, wyznaczenie jednej wersji jako priorytetowej jest najlepszą praktyką, zwłaszcza dlatego, że pozwala przekazać link juice do jednej wspólnej wersji.

Problemy z HTTP / HTTPS

Korzystanie z bezpiecznego szyfrowania jest wysoce zalecane dla wielu stron internetowych. W przypadku złej konfiguracji certyfikatu SSL większość przeglądarek internetowych uniemożliwi użytkownikom odwiedzenie witryny poprzez pokazanie im komunikatu „połączenie niezabezpieczone„. Jeśli dwie wersje twojej strony nie są ustawione prawidłowo, obie z nich mogą zostać zaindeksowane i spowodować duplikację treści, które mogą osłabić rankingi twoich stron internetowych

Strony z przekierowaniem 302

Przekierowania 302 są tymczasowe, więc nie przynoszą żadnego link juice. Jeśli używasz ich zamiast 301, wyszukiwarki mogą nadal indeksować stary adres i pominąć nowy jako duplikat, lub mogą podzielić link pomiędzy tymi dwoma wersjami, co źle wpływa na rankingi wyszukiwania.

Strony z przekierowaniem 301

Przekierowania 301 są trwałe i zazwyczaj wykorzystywane są do rozwiązywania problemów z duplikatami, albo jeśli adresy URL nie są już konieczne.Korzystanie z przekierowania 301 jest całkowicie uzasadnione, ponieważ przekierowanie 301 będzie przekazywać link juice ze starej strony na nową. Tylko pamiętaj, aby przekierować stare adresy URL do najbardziej odpowiednich stron

Długie łańcuchy przekierowań

W niektórych przypadkach, zarówno z powodu złej konfiguracji pliku .htaccess lub ze względu na pewne świadomie podejmowane działania. Zaleca się unikania przekierowywania sieci więcej niż dwukrotnie, ponieważ mogą one być przyczyną wielu problemów:

- Strony nie będą indeksowane, ponieważ roboty Google nie przechodzą przez ponad 5 przekierowań.

- Będą spowalniać prędkość strony.

- Wysoki współczynnik odrzuceń.

Strony z rel=”canonical”

W większości przypadków powielone adresy URL obsługiwane są przez przekierowanie 301. Jednak czasami, na przykład, gdy ten sam produkt pojawi się w dwóch kategoriach z dwóch różnych adresów URL i oba potrzebne są jednocześnie, można określić, która strona powinna być uznana za priorytetową z pomocą tagu rel = „canonical” .

Kod i czynniki techniczne SEO

Strona przyjazna dla komórek

Według Google, strona przyjazna dla urządzeń mobilnych wpływa na wyszukiwania we wszystkich językach na całym świecie i ma znaczący wpływ na wyniki wyszukiwania Google. Algorytm ten działa na zasadzie strona po stronie – on nie sprawdza, jak przyjazna jest strona, po prostu określa czy jest przyjazna smartfonom czy nie. Algorytm jest oparty na takich kryteriach jak małe rozmiary czcionek, łatwo dostępne linki, czytelne treści, widzenie zawartości.

HTTPS mixed content

Korzystanie z bezpiecznego szyfrowania jest zalecane dla wielu stron internetowych (na przykład przy transakcjach i zbieraniu poufnych informacji użytkownika.) Jednakże, w wielu przypadkach, webmasterzy stają w obliczu problemów technicznych podczas przełączania ich stron internetowych z HTTP na HTTPS. Jednym z tych problemów jest tzw. zawartość mieszana – tzn. gdy bezpieczne strony HTTPS wykorzystują niebezpieczne treści pobierane przez HTTP.

Duplikat kodu rel=”canonical”

Duplikaty kodu rel=canonical zdarzają się często w połączeniu z wtyczkami SEO, które wstawiają jako domyślny rel=canonical, prawdopodobnie bez wiedzy webmastera, który zainstalował plugin. Ponowne sprawdzenie kodu źródłowego strony pomoże rozwiązać ten problem

Ramki na stronie

Ramki pozwalają wyświetlać więcej niż jeden dokument HTML w tym samym oknie przeglądarki. W efekcie tekstu i hiperłączy (najważniejszych sygnałów dla wyszukiwarek) brakuje w takich dokumentach. Jeśli używasz ramek, wyszukiwarki nie będą prawidłowo indeksować cennych treści i nie będą wysoko pozycjonować strony internetowej.

Błędy i ostrzeżenia W3C HTML

Walidacja jest zwykle wykonywana przez W3C Markup Validation Service. I choć zgodność ze standardami W3C nie jest obowiązkowa i nie będzie miała bezpośredniego wpływu na SEO, zły kod może być przyczyną nieprawidłowego indeksowania ważnych treści przez Google. Zaleca się poprawienie zerwanych kodów twoich stron w celu uniknięcia problemów z robotami wyszukiwarek.

Błędy i ostrzeżenia W3C CSS

Błędy w CSS mogą być nieważne dla wyszukiwarek, ale mogą prowadzić do niepoprawnego wyświetlania strony dla odwiedzających, co z kolei może mieć wpływ na konwersję i współczynnik odrzuceń. Upewnij się, że strona jest wyświetlana poprawnie dla wszystkich ważnych dla ciebie przeglądarek (w tym mobilnych).

Analiza linków wewnętrznych

Niedziałające linki

Zerwane połączenia wychodzące mogą być sygnałem jakości dla wyszukiwarek i użytkowników. Jeśli witryna ma wiele nie działających linków logiczne jest, żeby stwierdzić, że nie została aktualizowana przez jakiś czas. W wyniku tego pozycja witryny może zostać obniżona.

Zewnętrzne linki dofollow

Najprościej mówiąc, linki Dofollow są linkami bez atrybutu rel=”nofollow”. Takie linki są dostrzegane przez wyszukiwarki i przekazują siłę PageRank.

Nie ma nic złego w linkowaniu do innych stron za pośrednictwem linków Dofollow, jeśli linkujesz do miejsc bardzo istotnych lub wysokiej jakości.

Audyt SEO obrazów

Niedziałające obrazy

Choć zerwane zdjęcia na stronie nie mają bezpośredniego wpływu na pozycję w wyszukiwarkach, na pewno zasługują na uwagę z dwóch powodów. Przede wszystkim, są one kluczowymi czynnikami wpływającymi na użytkownika i mogą spowodować u odwiedzających odrzucenie bez osiągnięcia swoich celów. A po drugie, brakujące obrazy mogą utrudnić indeksowanie witryny, marnując crawl budget i utrudniając robotom wyszukiwarki rozpoznanie niektórych z ważnych treści witryny.

Puste alt teksty

Chociaż wyszukiwarki nie mogą odczytać tekstu obrazu, atrybuty Alt (znane również jako „atrybuty alternatywne”) pomagają zrozumieć, co obrazy przedstawiają.

Najlepszą praktyką jest utworzenie tekstu zastępczego dla każdego obrazu, z użyciem w nim słów kluczowych, jeśli to możliwe, aby pomóc wyszukiwarkom lepiej zrozumieć treść twoich stron i tym samym osiągnąć wyższą pozycję w rankingach.

Meta tagi strony

Puste meta title i meta description

Jeśli strona ma pusty tag tytułowy, to Google i inne wyszukiwarki będą decydować na własną rękę, co z zawartości wyświetlić na stronie wyników.

Chociaż meta opisy nie mają bezpośredniego wpływu na rankingi, nadal są ważne, gdyż stanowią one fragment, który ludzie widzą w wynikach wyszukiwania.

Dlatego powinien on „sprzedawać” stronę w wyszukiwarkach i zachęcać odwiedzających do klikania. Jeśli meta description jest pusty, wyszukiwarki same będą decydować, co mają wyrywkowo uwzględnić. Najczęściej będzie to pierwsze zdanie na stronie. W rezultacie, takie fragmenty mogą być nieatrakcyjne i nieistotne.

Zduplikowane tytuły

Tytuł strony jest często traktowany jako najważniejszy element na stronie. Jest to wyraźny sygnał dla wyszukiwarek, ponieważ mówi im, czym strona jest naprawdę. To jest oczywiście ważne, że tytuł zawiera najbardziej znaczące słowa kluczowe. Tym bardziej, że każda strona powinna mieć unikalny tytuł, aby sprawić, że wyszukiwarki nie mają problemów w określeniu, które z stron internetowych są istotne dla tej czy innej kwerendy. Strony z duplikatami tytułów mają mniejsze szanse na wysokie rangi. Ponadto, jeśli witryna ma strony z duplikatami tytułów, również inne jej strony mogą mieć trudności w uzyskaniu wysokiego rankingu.

Zbyt długie tytuły

Każda strona powinna mieć unikatowy, bogaty w słowa kluczowe tytuł. Jednocześnie tytuł nie powinien być zbyt długi. Tytuły, które są dłuższe niż 70 znaków zostają obcięte przez wyszukiwarki i będą wyglądać nieatrakcyjnie w wynikach wyszukiwania.

Próbujesz zobaczyć twoje witryny wyświetlone na stronie 1 w wyszukiwarkach, ale jeśli tytuł jest skrócony i niepełny, nie przyciągną one tak dużo kliknięć, jak tego oczekujesz.

Zbyt długie description

Chociaż meta descriptions nie mają bezpośredniego wpływu na rankingi, nadal są ważne, gdyż stanowią one fragment, który ludzie widzą w wynikach wyszukiwania.

Dlatego powinien on „sprzedawać” stronę w wyszukiwarkach i zachęcać odwiedzających do klikania. Jeśli meta description jest zbyt długi, to będzie on obcięty przez wyszukiwarkę i może wyglądać nieatrakcyjne dla użytkowników.

Audyt SEO treści strony

Słowa kluczowe w tekście głównym

Jeśli docelowe słowa kluczowe są obecne w tekście strony internetowej, oznacza to większe szanse na wysoki ranking.

Sprawdzimy ile razy słowa kluczowe powtarzają się na docelowych podstronach, zmierzymy ich TF-IDF (ang. TF – term frequency, IDF – inverse document frequency)

Liczba słów w tekście

Strony internetowe z dużą ilością treści tekstowych mają tendencję do wyższych pozycji w wynikach wyszukiwania, gdyż uważane są za bardziej przydatne dla użytkowników. Jest to także dobrą praktyką, aby zamieszczać tekst powyżej podziału strony, ponieważ wyszukiwarki mogą kluczyć na stronach z ciężkimi reklamami i innymi treściami nietekstowymi.

Słowa kluczowe w H1

Jeśli docelowe słowa kluczowe są obecne w tekście strony internetowej, oznacza to większe szanse na wysoki ranking.

Sprawdzimy ile razy słowa kluczowe powtarzają się na docelowych podstronach, zmierzymy ich TF-IDF (ang. TF – term frequency, IDF – inverse document frequency)

Słowa w tagach H2 – H6

Tagi H2-H6 służą do oznaczania podpozycji na stronie (w przeciwieństwie do tagu H1, który jest używany do oznaczania głównego nagłówka). Ważne jest, aby przestrzegać hierarchii tagów H2-H6 na stronie, aby uniknąć mylącego wyszukiwarki kodowania. Na przykład, nielogiczne użycie tagu H3 przed H2, i tak dalej.

Pogrubione słowa kluczowe

Tekst pogrubiony jest używany na stronie, aby dać pewnym słowom dodatkową wagę. Na przykład, jeśli piszesz w kodzie:<strong>optymalizacja seo</strong> lub <b>audyt strony</b>).

Wyszukiwarki zwykle uważają słowa tekstu pogrubionego za nieco bardziej ważne niż słowa bez dodatkowego określenia.Słowa kluczowe kursywą

Kursywa (lub tekst kursywą) są wykorzystywane na stronie, aby dać pewnym słowom dodatkową wagę (np, jeśli piszesz w kodzieoptymalizacja stron internetowych lub <em>optymalizacja strony </em>.

Wyszukiwarki zwykle uważają słowa kursywą jako nieco bardziej istotne niż słowa bez dodatkowego określeniaSłowa kluczowe w odnośnikach

Teksty odnośników linków są widocznymi częściami mającymi związek z linkami znajdującymi się na stronie.

Chociaż wykorzystanie słów kluczowych w tekstach odnośników wzmacnia semantyczną całość twojej strony, jest bardziej prawdopodobne, że wyszukiwarki przypiszą znaczenie odnośnika tekstu linku do strony wskazywanej przez link.

Optymalizacja strony internetowej dla robotów wyszukiwarek

Kod statusu strony

Gdy użytkownik uzyskuje dostęp do strony w przeglądarce lub gdy Googlebot indeksuje stronę, serwer zwraca kod statusu HTTP w odpowiedzi na wniosek. Kod ten zawiera informacje na temat statusu wniosku. Niektóre typowe kody statusu to:

- 200 – serwer z powodzeniem zwrócił stronę

- 301 – strona została przeniesiona na stałe

- 404 – żądana strona nie istnieje

- 503 – serwer jest chwilowo niedostępny.

Zerwane zasoby strony

Choć zerwane zasoby (filmy, obrazy, pliki CSS, itd.) na stronie internetowej nie są bezpośrednio włączone do rankingu w wyszukiwarkach, na pewno zasługują na uwagę z dwóch powodów.

Przede wszystkim, są one kluczowymi czynnikami wpływającymi na użytkownika i mogą spowodować u odwiedzających odrzucenie bez osiągnięcia swoich celów.

Po drugie, zerwane zasoby mogą utrudnić indeksowanie witryny, marnując budżet i utrudniając robotom wyszukiwarki indeksowanie niektórych z ważnych treści witryny.

Ograniczenie indeksowania strony

Strona może być ograniczona w indeksowaniu na kilka sposobów:

- w pliku robots.txt

- przez tag X-noindex Robots-Tag

- przez tag noindex <meta>.

Ograniczenie indeksowania strony ma sens dla stron z poufnymi informacjami, starych egzemplarzy sprzedaży lub innego rodzaju stron, których nie chcesz pokazywać w wynikach wyszukiwania.

Zasoby wykluczone z indeksowania

W przypadku niektórych ważnych zasobów ograniczenie w indeksowaniu przez pomyłkę, może prowadzić do szeregu problemów w SEO.

Na przykład, obrazy ograniczone w indeksowaniu nie będą wyświetlane w wynikach wyszukiwania grafiki Google.

Blokowanie plików JS i CSS utrudnia Google przechodzenie strony prawidłowo i może spowodować, na przykład, że strona nie przejdzie testu na urządzeniach mobilnych wyszukiwarek (co z kolei będzie obniżało twoje rankingi mobilne)

Wykorzystywanie meta refresh

Meta refresh nie powinien być stosowany, ponieważ może to być postrzegane jako naruszenie Wytycznych Jakości Google

Wykorzystywanie meta rel canonical

W większości przypadków duplikaty adresów URL są obsługiwane za pomocą przekierowania 301. Jednak czasami, na przykład, gdy ten sam produkt pojawi się w dwóch kategoriach z dwóch różnych adresów URL i oba muszą istnieć na żywo, można określić, która strona powinna być uznana za priorytetową z pomocą tagu rel=”canonical”

Mobile friendly i szybkość działania

Strona przyjazna dla komórek

Według Google, przyjazny algorytm wpływa na mobilne wyszukiwania we wszystkich językach na całym świecie i ma znaczący wpływ na rankingi Google.

Algorytm ten działa na zasadzie strona po stronie – on nie sprawdza, jak przyjazna jest strona, po prostu określa czy jest przyjazna smartfonom czy nie.

Prędkość ładowania strony

Szybkość strony jest uważana za czynnik, który może określić pozycję strony na listach wyników wyszukiwania. Jest również znany jako czynnik „czasu ładowania strony” i wskazuje czas potrzebny na wyświetlenie zawartości na stronie.

Wydajność szybkości strony jest podsumowaniem analizy różnych parametrów, w tym rozmiaru obrazu, rozmiaru css, zasobów blokujących renderowanie, kompresji tekstu, żądań klucza wstępnego i innych

Adres URL strony internetowej

Dynamiczny adres strony

Adresy URL, które zawierają dynamiczne znaki takie jak „?” i parametry, nie są przyjazne dla użytkownika, a ich charakter nie jest opisowy i są trudniejsze do zapamiętania.

Jak twierdzą Wytyczne Google dla Webmasterów, „adresy URL powinny być czysto kodowane wg najlepszych praktyk, i nie zawierać znaków dynamicznych.”

Długość adresu URL strony

Ogólną zasadą jest, aby starać się utrzymać krótkie adresy URL. Krótsze adresy uzyskują więcej kliknięć w wynikach wyszukiwania, są łatwiejsze do zapamiętania i wyświetlane są bez problemu w przeglądarkach.

Poza tym, maksymalna długość adresu URL obsługiwana w przeglądarkach waha się , a niektóre przeglądarki mogą nie być w stanie analizować zbyt długich adresów URL.

Skontaktuj się z nami i uzyskaj bezpłatną wycenę

Powiedz nam, co potrzebujesz, a my oszacujemy koszt w ciągu 48 godzin.